近日,创新创业学院HPC团队具身智能、大模型应用及流视频分割方向的四项成果被国际顶级会议和期刊接收。

成果一:知识驱动的机器人视觉导航

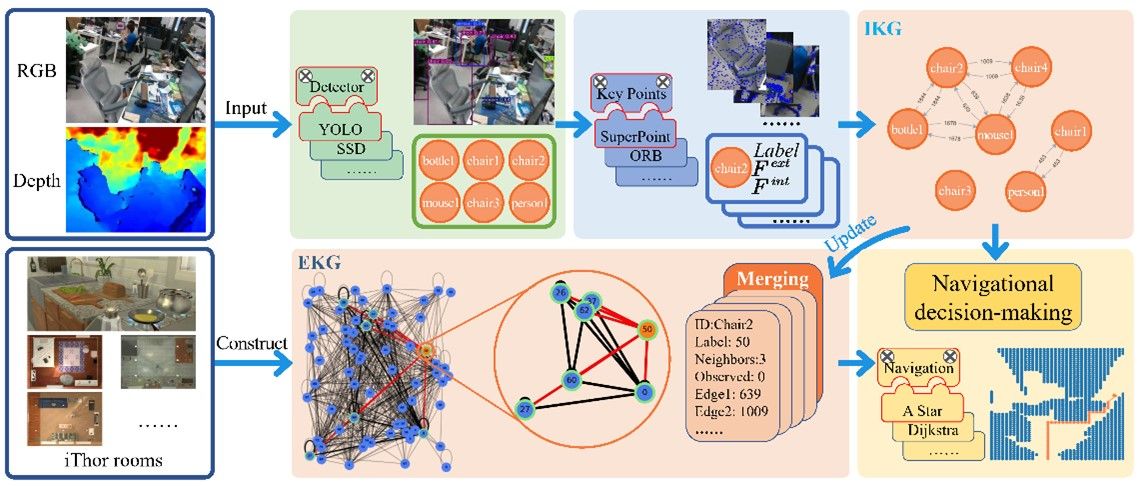

团队具身智能成果“Knowledge-Driven Visual Target Navigation: Dual Graph Navigation”被国际顶级机器人学术会议ICRA 2025接收。该项成果由硕士生李世垚(2023级)、本科生孟子洋(2022级)、刘胜蓝副教授(通讯作者)和王飞龙工程师等合作完成。

该项成果提出了一种新的图像目标导航技术架构DGN(Dual Graph Navigation)。与现有技术相比,DGN基于双层拓扑图网络进行环境探索和导航决策,具有轻量化和模块化的特点,并且成功地被部署在自制服务机器人、宇树机器狗Go2等不同硬件的机器人平台上。

成果二:基于大模型的视频片段检索

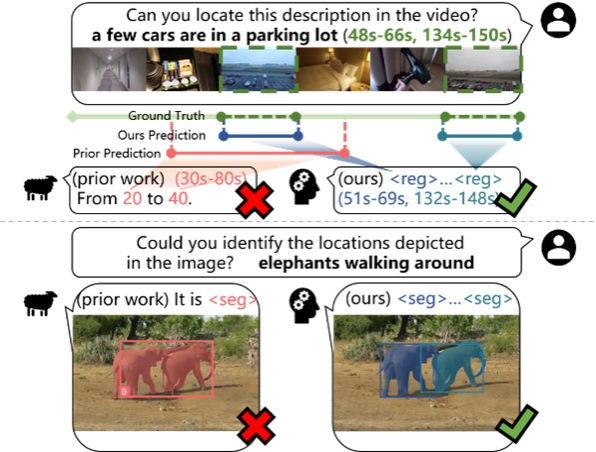

团队的视频片段检索成果“DTOS: Dynamic Time Object Sensing with Large Multimodal Model” 被计算机视觉国际顶级学术会议CVPR 2025接收。该项成果由硕士生田济睿(23级),张津榕(22级)和刘胜蓝副教授(通讯作者)等合作完成。

该项目设计了DTOS-LLM框架用于视频引用对象分割任务,其可以根据用户的文本指令查找出引用目标的空间掩码序列和对应事件发生的片段,并且采用多个特殊token的形式丰富了大语言模型的表达能力,最终在多个数据集上实现了SOTA的效果。

成果三:基于扩散模型的流视频时序动作分割

团队的流视频分割成果“Flexible Streaming Temporal Action Segmentation with Diffusion Models”被多媒体旗舰会议ICME 2025接收。该项成果由硕士生张津榕(22级)和刘胜蓝副教授(通讯作者)等合作完成。

该项成果提出了一种基于扩散模型的动态流式时间行为分割模型(FSTAS-DM)。通过利用具有不同特征分布的视频片段作为控制条件,我们的模型能够适应训练和测试领域之间分布的变化和不一致。此外,我们还引入了一种多阶段条件控制训练策略(MSCC),该策略增强了模型的时间泛化能力。

成果四:基于强化学习的流视频时序动作分割

团队的流视频分割成果“End-to-End Streaming Video Temporal Action Segmentation with Reinforcement Learning”被中国科学院top期刊TNNLS接收。该项成果由硕士生张津榕(22级)和刘胜蓝副教授(通讯作者)等合作完成。

该项成果提出了一种基于强化学习的端到端流式视频时间行为分割模型(SVTAS-RL)。端到端建模方法缓解了任务性质变化带来的建模偏差,增强了在线解决方案的可行性。强化学习被用于缓解优化困境。通过大量实验,SVTAS-RL模型在多个数据集上显著优于现有的STAS模型,在超长视频数据集EGTEA上展现出了显著优势。

上一条:学生创业的从0到1——奇绩创业公开宣讲课来啦!

下一条:中国国际大学生创新大赛(2024)银奖项目展示(1)